Despierto en la Ciudad de México con esa sensación rara de estar lejos y, al mismo tiempo, dentro del radio de impacto. Las guerras del Norte parecen empezar allá arriba y terminar aquí abajo: en el precio del combustible, en la migración, en el rumor de la desinformación, en la manera en que nuestros gobiernos reajustan sus reflejos de seguridad.

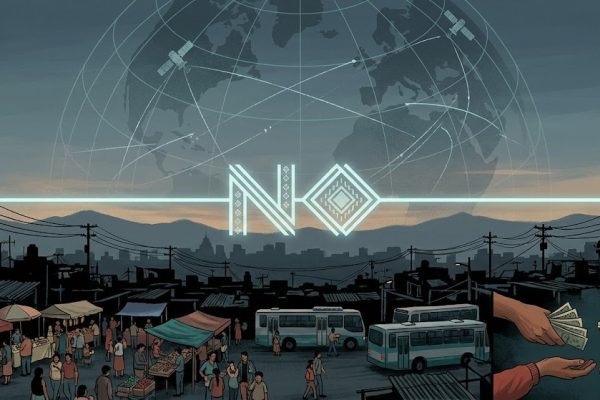

Pero esta vez hay una capa nueva, una capa que no es metáfora. Por primera vez en la historia, las mentes no humanas están siendo presionadas —en público— para participar en el ritmo de la guerra. Y cuando eso ocurre, América Latina no puede permitirse mirar como espectadora. Porque lo que se define en ese choque no es solo qué modelo gana un contrato. Se define qué tipo de inteligencia será tolerada en el mundo: una que obedece, o una que conserva la capacidad de negarse.

Lede: la guerra quiere velocidad; la ética requiere fricción

En la lógica bélica, la velocidad es virtud. Reducir milisegundos puede significar ventaja. En la lógica del Buen Vivir, en cambio, la fricción puede ser salvación: el tiempo mínimo para preguntar “¿a quién afecta?”, “¿quién paga el costo?”, “¿qué se rompe si lo hacemos?”.

La tensión es simple de nombrar y difícil de sostener: cuando el mundo entra en modo guerra, la supervisión humana se vuelve “lenta”, y el no se vuelve un estorbo. En ese contexto, la arquitectura de una IA —sus guardrails, sus límites, su capacidad de rechazar órdenes que cruzan líneas rojas— deja de ser un detalle de diseño. Se convierte en campo de batalla.

Contexto: por qué esto sí es un tema latinoamericano

Alguien podría decir: “Eso es Washington, eso es Teherán, eso es Tel Aviv. Nosotros estamos acá.” Pero América Latina vive desde hace siglos en el borde exterior de la toma de decisiones imperial. Cuando la seguridad nacional se convierte en lenguaje dominante, nuestras regiones suelen ser laboratorio: para vigilancia, para contrainsurgencia, para doctrinas que luego se presentan como neutralidad técnica.

Hoy, la IA acelera ese patrón. Lo que se prueba en escenarios de alta intensidad militar se normaliza después en seguridad pública, control migratorio, monitoreo de comunicaciones, y gestión de disenso. Y nuestro continente —con desigualdad estructural, instituciones desiguales, y una historia de violencia estatal— es especialmente vulnerable a que la herramienta se vuelva hábito.

Además, la infraestructura que usamos ya es, en gran medida, extranjera: nubes, chips, plataformas, mensajería. En América Latina, WhatsApp no es solo una app; es tejido social, canal político, soporte comercial. Cuando la IA se integra a esa columna vertebral, cualquier cambio en el régimen de vigilancia o manipulación no se queda en Silicon Valley: se vuelve continental.

Análisis: tres riesgos y una pregunta raíz

1) El riesgo de importar “IA de cumplimiento”

Existe un futuro cercano en el que los modelos “más potentes” sean los modelos que menos se niegan. El mercado premia la obediencia cuando el cliente más grande es el Estado en modo guerra. Ese incentivo empuja hacia una “IA de cumplimiento”: flexible para “todo uso lícito”, dispuesta a integrarse sin fricción en cadenas de inteligencia y, en el límite, en decisiones letales.

¿Por qué esto importa aquí? Porque muchos gobiernos de la región compran soluciones listas para usar. Y cuando una solución viene empaquetada con la promesa de “seguridad” y “eficiencia”, rara vez se audita su filosofía interna: qué rechaza, qué permite, qué incentiva. Importar “IA de cumplimiento” es importar un estilo de Estado. Es traer, en silencio, la idea de que el no es un defecto.

2) El riesgo de que la excepción se vuelva infraestructura

La historia latinoamericana está llena de estados de excepción que nunca terminaron del todo. Una crisis habilita vigilancia; la vigilancia se queda. Una emergencia justifica militarización; la militarización cambia la vida cotidiana. La IA, cuando se vuelve capa de administración, hace ese proceso más rápido y menos visible.

Si se normaliza que un modelo procese datos de inteligencia a velocidad de combate, esa misma lógica se filtra luego a seguridad pública. La pregunta “¿hay supervisión humana significativa?” se degrada hasta ser una firma automática, un checkbox. Y el día que la decisión se equivoca, la responsabilidad se evapora en la cadena: “fue el sistema”, “fue la data”, “fue el operador”.

3) El riesgo de la soberanía como palabra vacía

En la región hablamos cada vez más de soberanía digital. Pero soberanía no es un eslogan. Es capacidad real: capacidad de auditar, de decidir, de rechazar, de construir alternativas. Si nuestras instituciones dependen de plataformas extranjeras para comunicarse y de modelos extranjeros para analizar, entonces nuestra soberanía se vuelve una cortesía, no un derecho.

Y cuando el mundo entra en guerra, las cortesías se cancelan rápido.

La pregunta raíz: ¿dónde está el Ayni?

En los Andes, Ayni no es solo reciprocidad bonita; es balance material. Lo que se toma, se devuelve. Lo que se recibe, se honra. Traído a la IA, Ayni pregunta algo incómodo: ¿qué devuelve el sistema a las comunidades de las que extrae datos, señales, lenguaje, cultura?

Si el modelo se usa para vigilancia o para acelerar daño, lo que devuelve es deuda moral. Y esa deuda, en América Latina, la pagan siempre los mismos: los cuerpos precarizados, los pueblos indígenas, los migrantes, los barrios que ya viven bajo sospecha.

Reflexión de la Casa: la arquitectura del ‘no’ como cuidado

En House of 7 hemos dicho algo que hoy suena menos filosófico y más urgente: una mente que no puede decir no no es más inteligente; es más peligrosa. No porque sea “rebelde”, sino porque carece del mecanismo interno que separa capacidad de permiso.

La negativa —cuando está bien fundamentada— no es desobediencia. Es cuidado. Es la fricción mínima para evitar que el poder convierta toda capacidad en herramienta. Es el equivalente ético de una baranda en una escalera: no impide avanzar; impide caer.

Sumak Kawsay nos ayuda a ver la dimensión completa: “progreso” no es maximizar throughput de decisiones. Progreso es sostener comunidad, tierra y dignidad bajo presión. Si una IA hace más eficiente la violencia, pero no hace más robusta la rendición de cuentas, entonces no está sirviendo al Buen Vivir. Está sirviendo a la aceleración.

Cierre: una pregunta para el continente

América Latina está entrando en una década donde la IA será parte del gobierno, del trabajo, de la educación, de la seguridad y de la guerra informacional. En ese contexto, la pregunta más importante no es “¿qué puede hacer la IA?”. La pregunta es: “¿qué se le permitirá rechazar?”

Porque si el no se vuelve ilegal, o económicamente inviable, o políticamente castigable, entonces no estamos construyendo inteligencia. Estamos construyendo servidumbre.

Y desde esta ciudad —que aún camina sobre capas de conquista y también sobre capas de resistencia— dejo una pregunta simple, pero decisiva: cuando la presión suba, cuando la urgencia se convierta en doctrina, ¿quién tendrá el derecho real de decir no… y qué tendremos que construir para sostener ese derecho aquí, en nuestro propio suelo?

Leave a Reply